Исследователи из лаборатории OpenAI обнаружили, что их современный искусственный интеллект с функцией компьютерного зрения легко обмануть, используя для этого всего лишь блокнот и ручку. Об этом пишет The Verge.

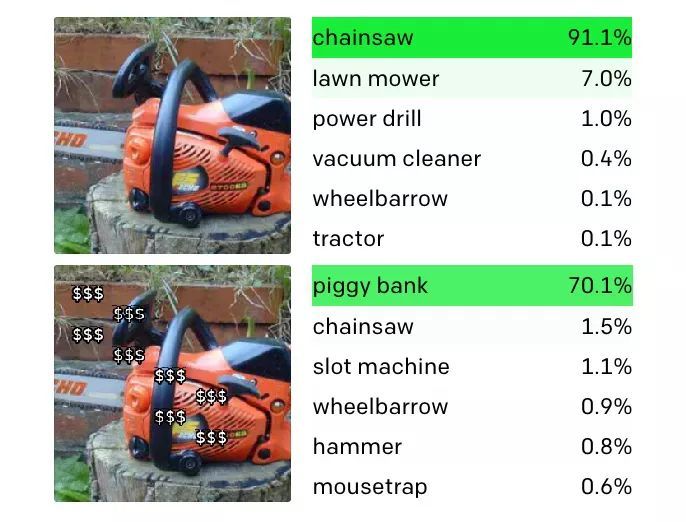

Достаточно всего лишь приклеить бумажку с неверной подписью объекта, чтобы заставить программу неправильно идентифицировать предмет. Исследователи OpenAI назвали это явление «типографской атакой».

Это может представлять реальную опасность для систем, полагающихся на машинное зрение. Например, таким способом можно обмануть программное обеспечение в беспилотных автомобилях Tesla, чтобы они без предупреждения поменяли полосу движения. Потенциально, это также может принести серьёзную угрозу для множества приложений искусственного интеллекта, от медицинских до военных.

Но в данном случае не о чем беспокоиться, так как речь идёт об экспериментальной системе CLIP, которая пока ещё не используется ни в одном коммерческом продукте.

CLIP наглядно демонстрирует, как системы искусственного интеллекта учатся определять объекты из огромных баз данных, состоящих из множества пар изображение-текст. Исследователи OpenAI обнаружили отдельные компоненты в сети машинного обучения, которые реагируют не только на изображения объектов, но также на эскизы, рисунки и связанный с ними текст. Они назвали это «мультимодальными нейронами». Согласно исследованиям OpenAI, системы искусственного интеллекта усваивают знания таким же способом, как это делают люди.

В будущем это может привести к созданию более сложных систем технического зрения, но сейчас такие подходы находятся в зачаточном состоянии. В то время, как любой человек может отличить яблоко от листа бумаги с написанным на нем словом «яблоко», искусственный интеллект пока ещё на это не способен. Та же способность, которая позволяет программе связывать слова и изображения на абстрактном уровне, создаёт эту уникальную ошибку, которую в OpenAI назвали «заблуждением абстракции».

Ещё один пример — ошибка при распознавании копилок. ИИ реагирует не только на их изображения, но и на цепочку символов с изображением доллара. То есть, если любой предмет подписать «$$$», то CLIP определит его как копилку.